フィジカルAIとケアのこと

2024年、中国の介護労働者の不足は550万人に達した。障害のある高齢者は4,000万人を超えた[1]。韓国は同じ年に「超高齢社会」に突入した。日本では2019年時点で介護施設の約10%がロボットを導入した経験があり、政府は普及を国家戦略として推進している[2]。

2025年、BMWのスパータンバーグ工場でカリフォルニアのロボティクス企業Figure AIのヒューマノイドが板金部品を運んだ。11ヶ月間のパイロットで3万台以上のSUVの生産に関与した[3]。同じ年、NVIDIAのCEOジェンスン・ファンは米国の大規模家電見本市CES 2026の基調講演でこう言った。「ロボティクスに、ChatGPTの瞬間が来た」[4]。ChatGPTはOpenAIが2022年に公開した対話型AIで、生成AIの普及を象徴するプロダクトだ。ファンはその衝撃がロボティクスにも到来しつつあると宣言した。

板金を運ぶことを学んだ機械が、次に誰の身体に触れようとしているか。この論点を、フィジカルAIと呼ばれる技術の現在地から考えたい。

三つの変化

フィジカルAIとは何か。

従来の産業ロボットはルールベースだった。特定の位置に特定の物体が来ることを前提に設計され、明示的にプログラムされた動作を繰り返した。精度は高い。スピードも速い。ただし想定外の状況に対応できなかった。物体の向きが少しずれれば止まる。初めて見る形状のものは把持できない。

フィジカルAIはその制約を変えようとしている。変化の核心は三つある。

ひとつは学習の方式だ。事前のプログラムではなく、シミュレーションや実際の経験から動作を学習する。転倒しない歩き方、物体をつぶさない力加減、障害物のよけ方。これらを無数の試行錯誤から獲得する。

ふたつめはセンサーの密度と質だ。高解像度カメラ、LiDAR(光検出・測距センサー)、次世代の触覚センサーが組み合わさり、ロボットはリアルタイムで複雑な環境を認識・解釈できるようになった[5]。温度、圧力、光量、空間的位置。物理世界から取得できる情報量が桁違いに増えた。

三つめはフィードバックループだ。行動の結果が次の行動に反映される。Amazonの物流倉庫のSparrowと名付けられたシステムは、同社の在庫の約65%のアイテムを自律的に処理できるとされる[5]。把持に成功するたびに学習し、失敗するたびに修正する。経験によって変化するシステムだ。

コーヒーカップを持ち上げるとき、人は重さを計算しない。中身がどれだけ入っているか、カップは薄い陶器か厚いマグか、といった状況に応じて自然に力を調整する。触れた場所が熱ければ反射的に指を離す。その一連の動作に意識は介在しない。身体が知っている、と言うほかない動きだ。フィジカルAIが目指しているのは、この「身体が知っている」という事実の機械的な実装だ。問題は、そのシステムが何から学んでいるか、誰の動きを「標準的な身体の動き」として学んでいるかだ。この点には後で触れる。

70年の迂回

フィジカルAIの直接の祖先は、20世紀半ばにある。

1940年代の終わり、MITの数学者ノーバート・ウィーナーは「サイバネティクス」という概念を打ち立てた。人間と機械における制御と通信の科学だ[6]。フィードバックに基づく自己調整、環境との相互作用から行動が生まれること。これがサイバネティクスの核にあった。1948年から1949年にかけて、英国の神経生理学者ウィリアム・グレイ・ウォルターがバーデン神経生理学研究所(ブリストル)で「エルシー」と「エルマー」と名付けた自律型ロボットを作り、充電ステーションへ自力で戻れることを示した[7]。

ところが1956年、方向が変わる。米国の計算機科学者ジョン・マッカーシーらがダートマス会議で「人工知能」という概念を定式化した。そのビジョンはシンボリックで、ルールベースで、アルゴリズム的だった。機械は有機体のように環境から学習するのではなく、論理に従うべきだという考え方だ。サイバネティクスの直観(知性は身体と環境の相互作用から生まれる)は後景に退いた。

シンボリックAIは成功を収めた分野もあった。チェス、定理証明、言語処理の一部。ただし現実の物理環境での動作には弱かった。予測不能な状況、曖昧な知覚、無限の文脈。これらを形式的なルールで捌くことの限界は、早くから指摘されていた。

転換点のひとつが1991年に来る。MITのロボティクス研究者ロドニー・ブルックスが「Intelligence without representation(表象なき知性)」という論文を発表した[8]。複雑な内部表象やアルゴリズムなしに、自律機械と環境のシンプルな物理的相互作用から知的行動が生まれうるという主張だった。知性とは記号の操作ではなく、世界との関係の中にあるという宣言でもあった。

その後、深層学習の発展、強化学習の精緻化、計算資源の爆発的拡大が重なった。

なぜいま「フィジカルAI」なのか。技術・経済・社会の三つの変化が重なっている。

技術的には、LLMの登場が決定的だった。以前のロボットは動作を一つずつプログラムする必要があった。「赤い箱を左の棚に置いて」という自然言語の指示を理解して実行できるようになったのは、ごく最近のことだ。ロボットに「手足」だけでなく「言語理解」が加わった。同時に、高解像度カメラや触覚センサーといったハードウェアのコストが急落し、仮想空間で数百万回訓練してから現実に展開する「シミュレーション転送」が実用的になった[9]。

指摘しておきたいのは、これが極めて逆説的な経路だという点だ。身体から知性が生まれるという70年来の直観を実現するための技術が、最も非身体的な経路(テキストだけから発達した言語モデル)に依存している。

経済的・社会的には、労働力不足が駆動している。少子高齢化による人手不足は日本だけの話ではなく、米国でも欧州でも深刻だ。加えて米国ではリショアリング(製造業の国内回帰)政策が進み、工場を国内に戻したくても働き手がいないという状況が生まれている。

サイバネティクスが「負けた」1956年から約70年。その直観が形を変えて戻ってきた、というのが現在地だ。

ただし、先ほど見たように、順序が逆になっている。サイバネティクスの直観では、身体が最初にあった。エルシーとエルマーは最初から身体だった。フィジカルAIでは、LLMという言語モデルが最初にある。身体は後から追加される。後付けの身体。

借用された思想

フィジカルAIの言説には、ある思想的な直観が流れている。知性は身体と環境の相互作用から生まれるという考え方だ。研究者の論文にも、企業のビジョン文書にも、この直観への参照がある。

その源泉のひとつがフランスの現象学者モーリス・メルロ=ポンティだ。1945年に『知覚の現象学』で彼が提示したのは、知覚は脳の中の冷えたプロセスではなく、身体が世界の中で動き、触れることによって成立するという論点だった[10]。私たちは身体を「持つ」のではなく、身体で「ある」。メルロ=ポンティのこの定式は今も頻繁に引用される。

メルロ=ポンティを受け継ぎ、1991年にチリ出身の生物学者・神経科学者フランシスコ・ヴァレラ、カナダを拠点とする哲学者エヴァン・トンプソン、米国の認知心理学者エレノア・ロッシュが展開したのが「エナクティヴ・アプローチ」だ[11]。認知は所与の現実を表象することではなく、有機体が環境との関わりを通じて世界を能動的に構成することだ、という立場だ。

もう少し具体的に言う。慣れたハンマーを使うとき、人はハンマーの重さや長さをいちいち計算しない。ハンマーの先端が自分の手の延長のように感じられ、釘を「見る」のではなく打つ場所を「感じる」。これはハンマーを頭の中で表象しているのではなく、身体がハンマーとの関係の中で再構成された状態だ。知識は身体を通じて世界に根ざしている、というのがエナクティヴィズムの核心だ。

フィジカルAIが目指す「センサー入力から直接行動へ」の設計原理は、この直観と構造的に対応している。

ただし近似と原型のあいだには、いまだ埋まらないずれがある。

現象学の系譜には、ドイツの哲学者エドムント・フッサールに由来する「ケルパー(Körper)」と「ライブ(Leib)」の区別がある[12]。ケルパーは物体としての身体、測定可能な対象としての身体だ。ライブは「私が生きているものとしての身体、生きられた身体」。経験の器官、感覚の場、世界への一次的なアクセス様式だ。

ロボットのセンサーが取得するのはケルパーの情報だ。温度は数値として計測される。圧力は電気信号に変換される。空間は座標として記述される。センサーが「熱さを感じる」ことはない。そこにはライブに相当するものがない。

この違いはどれほど重要か。フィジカルAIの工学者にとっては「まだ実装されていない機能の問題」かもしれない。現象学の立場からは「原理的に別の事態」だ。どちらが正しいかは、現時点で決着していない。ただ、そのずれが存在することは確かだ。そして同様のずれが、フィジカルAIを動かすLLMの中にも、別の形で現れている。

実存の外骨格

フィジカルAIのロボットは、設計者を選ばない。訓練データを選ばない。展開される環境を選ばない。ただそこに置かれ、与えられた条件の中で動く。

ドイツの哲学者マルティン・ハイデガーはこれに似た事態を人間について述べた。「被投性(Geworfenheit)」、世界に投げ込まれていること。私たちは生まれる時代、言語、身体を選ばない。気づいたときにはすでに世界の中にいる。存在することを選ばずに、存在している。

だがハイデガーにとって、被投性はそれだけで終わらない。投げ込まれた存在は同時に「ケア(Sorge)」を持つ。ここで言う「ケア」は日常語の「ケア」でも、介護という意味でもない。ハイデガーが指しているのは、存在論的な構造だ。人間という存在だけが、自分自身の存在を「問題として引き受けている」という事態を指す。

ハイデガーによれば、石は自分が石であることを気にしないという。ハンマーは自分がハンマーであることを問わない。人間だけが、自分がどう生きるかを「問題として抱えた状態で」存在している。この「自分の存在が自分にとって問題になっている」という構造が、Sorgeだ。

だから人間は、作業がうまくいかないとき、単に処理が止まるのではなく、「自分が何をしようとしていたか」が揺らぐ。道具が壊れると、自分の目的、自分の計画、自分がこの世界でどうあろうとしているかが、一瞬だが表面に浮かび上がる。人間の行動の背後には常に、自分の存在への引き受けがある。これがSorgeの働きだ。

米国の哲学者ヒューバート・ドレイファスは1972年の著作『コンピュータには何ができないか』でこの観点からAI批判を展開した[13]。古典的なAIは世界をシンボルの集合として記述し、推論によって操作しようとする。そこには「使われることで意識から消える道具」がない。大工がハンマーを使うとき、ハンマーは意識の前景から消える。それが熟練した使い方の証だ。AIにはこの「消え方」がない。

数十年後、身体を持つロボットが登場したとき、ドレイファスの議論は再評価される。身体を持てばハイデガー的な知性に近づけるのではないか、という発想だ。「ハイデガーAI」と呼ばれる研究プログラムが生まれた[14]。

ドレイファス自身が晩年に書いたように、ハイデガー的な知性を実装しようとするなら、「私たちの欲求、欲望、喜び、痛み、動き方、文化的背景を持つ私たちの身体と非常によく似た身体のモデルをプログラムに組み込まなければならない」[14]。身体だけあっても足りない。その身体に何かが「かかっている」こと(Sorgeの構造)が必要だ。

フィジカルAIのロボットは被投性を持つ。世界に投げ込まれ、環境との相互作用の中で動く。Sorgeがあるかどうかは、現時点でわからない。把持に失敗したとき、エラーログが記録され、モデルが更新される。そのプロセスの中に「自分の存在の引き受け」があるかどうか。これは未決の問いだ。ただ少なくとも、そのような引き受けが設計としてじゅうぶんに意図されているとは言えない。

米国の哲学者ジョン・ホーゲランドの言葉を借りれば、コンピュータは「気にしない(don't give a damn)」[15]。実存主義は、まず存在があり、世界との関わりの中で意味が生まれると言った。フィジカルAIはその前半だけを持っている。存在があり、世界との関わりがある。意味が生まれる主体がいない(ということになっている)。実存の形式が、それを担う者なしに動いている。これが「実存の外骨格」と呼べる状態だ。

脳のない身体、身体のない脳

逆転の中身を、もう少し細かく見ていく。

フィジカルAIの主流的な設計は「LLMを脳にしてロボットの身体をつける」というものだ。LLMが高レベルの推論と計画を担い、ロボットの知覚・行動システムがそれを実行する。「赤い箱を左の棚に置いて」という自然言語の指示をロボットが理解して動く。これが実現した理由は、LLMがあるからだ。

LLMはシンボリックAIではない。この点はまず確認しておく必要がある。1956年のダートマス会議以降主流だったシンボリックAIはルールベースで、人間が明示的に記述した記号と論理によって動いた。ドレイファスが批判したのはこの設計だ。

LLMはその対極にある。コネクショニズム(ニューラルネットワークによってデータからパターンを学習する設計思想)の系譜の極点だ。膨大なテキストから統計的な構造を自律的に学習する。シンボリックAIが「AIの冬」で行き詰まった後、深層学習を経て発展した技術だ。

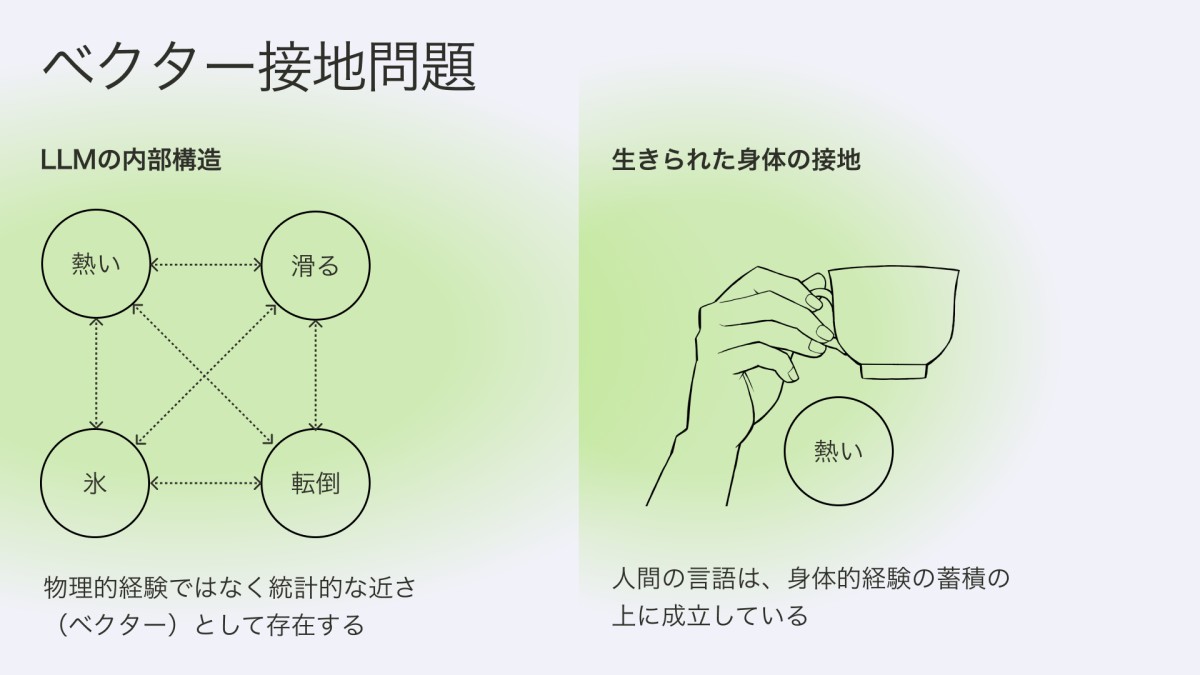

ではLLMは「身体から知性が生まれる」という直観に近いのか。そうではない。学習するのはテキストだ。「熱い」「滑る」「重い」。これらの語はLLMの中に存在するが、それは熱さを感じた経験ではなく、それらの語について書かれた文章のパターンだ。「滑る」は「氷」「転倒」「床」といった語との統計的な近さとして内部に存在する。物理世界との接触ではなく、言語の中での関係だ。

「記号はどうやって現実世界のものを指すのか」という問いは、1990年代から「記号接地問題(symbol grounding problem)」として知られてきた。LLMはシンボルではなくベクターを使うので、研究者はこれを「ベクター接地問題(vector grounding problem)」として再定式化した[16]。LLMでは語は高次元ベクター、つまり数値の束として処理される。そのベクターは他のベクターとの関係によって「意味」を持つが、物理世界との直接の接触には根ざしていない。言語を言語で学んだシステムが、言語を言語の外に接続できるか、という問題だ[17]。

生物においては、知性は身体を持つことで発達したとされる。人間の言語もまた、身体的経験の蓄積の上に生まれた。LLMはその逆の経路をたどった。身体なしに、テキストだけから言語を獲得した。そのLLMを脳として使い、後から身体をつける。これが現在のフィジカルAIの構造だ。身体から知性が生まれるという直観を実装しようとして、知性を先に作ってから身体をつけている。発達の順序が逆になっている。

ここに、「三つの変化」のセクションで先送りにした論点が戻ってくる。LLMはテキストから学んだ。それはインターネット上のテキストであり、主流のモデルにおいては英語が中心で、特定の人口の経験が「普通の言語」として刷り込まれている。その言語を「標準」として学習したシステムが、他の言語・経験を「標準でないもの」として処理する。フィジカルAIも同じ構造を持つ。工場の床、倉庫の棚、製品の形状。それらを「標準的な身体の動き」として学習したシステムが、別の身体・別の環境に展開されるとき、標準から外れたものを処理できない、あるいは処理のための枠組みを持たない。LLMの「標準言語」とフィジカルAIの「標準身体」は、同じメカニズムによって排除を産出する。

世界モデルの外側

論点を絞る。誰の身体が、このシステムの「世界モデル」(システムが内部に構築する環境)に入っているか。

AmazonのSparrowが覚えたのは、DVDとビタミン剤とぬいぐるみの把持だ。BMWのスパータンバーグ工場でFigureのヒューマノイドが覚えたのは、板金部品の搬送だ。これらのシステムが「次の展開先」として向かおうとしているのが、介護施設だ。

Amazonの倉庫では、過去7年間にわたり、労働者が負傷する可能性が他の倉庫と比べてほぼ2倍だった。[18]。Sparrowが学んだのは、そのような環境で動き回る手順だ。板金を扱う工場で学んだシステムも同様だ。

その訓練環境の身体は、製品だ。硬く、均質で、予測可能で、計測可能だ。介護施設にいる身体とは大きく異なる。

ところで、介護ロボットの開発は今始まったことではない。日本では20年以上、公的資金を投じて専用設計の介護ロボットが開発されてきた。PaRo(セラピー用ロボット)、Hug(移乗支援)、Robear(抱き上げ)、Pepper(レクリエーション)。いずれも広くは普及しなかった。購入されたロボットの多くが数週間後に棚にしまわれたという[19]。

なぜ普及しなかったか。英国の人類学者ジェームス・ライトは18ヶ月の現地調査をもとにこう分析している。第一はコストの問題だ。導入コストが高いことに加え、現場の労働を減らすのではなく増やした。ロボット自体の移動・メンテナンス・説明・監視に職員の時間がとられた。第二は技術的能力の限界だ。介護現場の変数は多すぎた。移乗ロボットのHugは数日で使われなくなり、Robearは実験段階を出られなかった。第三は設計者と現場のギャップだ。開発者は技術的課題を切り分けて解くことに集中し、高齢者や介護職員の実態からの十分な入力がないまま設計が進められた[19]。

フィジカルAIは、専用設計のロボットが20年かけて越えられなかった壁に、別の方向から向かっている。工場と倉庫で訓練されたシステムを、介護に転用する。

ILO(国際労働機関)の2024年報告によれば、移民女性労働者の28.8%がケア労働に従事している。移民でない女性の19.2%より高い割合だ[20]。介護労働は歴史的に、女性の労働、移民の労働、低賃金の労働として組織されてきた。フィリピン、インドネシア、ベトナムから日本へ。メキシコ、中米から米国へ。中国農村から都市へ。

フィジカルAIが介護に入るとき、代替されるのは主にこの人々だ。

「介護労働力不足」という問題の立て方そのものが、すでに政治的な選択だ。介護労働に十分な対価を払う、あるいは移民労働者の権利と待遇を大幅に改善する選択肢は、なぜか「解決できない問題」として最初から括弧に入れられる。「機械で代替する」ことが実行可能な解として残る。ベラルーシ出身のテクノロジー批評家エフゲニー・モロゾフがソリューショニズムと呼んだのは、まさにこの操作だ。複雑な社会的問題を、技術的に実装可能な「解決策」の問題に書き換えること。労働不足はフィジカルAIを正当化する。フィジカルAIは労働不足を前提にする。その円環の中で、ケア労働者の不可視化は続く。

これを「技術の進歩」と呼ぶことはできる。ただしそこには二重の排除がある。介護される人の多様な身体(たとえば、骨が脆く、皮膚が薄く、痛みの閾値が低い、「標準」から外れた身体)と、介護する人の労働(移民女性を中心とする、長い間不可視にされてきた労働)が置き換えられる。LLMが言語化できない経験を処理の外に落とすのと同じ構造がここにある。

「ロボティクスに、ChatGPTの瞬間が来た」という言説は、技術的な飛躍への興奮を正確に反映している。70年の迂回を経て、サイバネティクスの直観が工学的な力を持ち始めたことも事実だ。

ただしフィジカルAIが参照している思想は、「測定できる身体」と「生きられた身体」を区別していた。工学が実装しているのは前者だ。後者(熱さを感じること、慣れること、標準から外れた身体で世界に住まうこと)は、設計の外に置かれている。

ハイデガーの「ケア(Sorge)」と、日本語で「介護」と呼ぶケアは、同じ言葉を使っているが指しているものが違う。ハイデガーのSorgeは、人間が自分の存在を問題として引き受けているという存在論的な構造だ。介護のケアは、他者の身体と生活を実際に支える行為だ。

ただし、この二つには接点がある。介護というケアの形式は、他者の存在を自分の懸案として引き受けることを求める。この人が痛くないか、この人は眠れているか。他者の生の可能性が、介護する人の行為の方向を決める。それは「情報処理」ではなく、他者の存在への引き受けだ。ハイデガーが言うSorgeの構造と、同じ形をしている。

フィジカルAIのロボットがこの構造を持つかどうかは、現時点でわからない。把持に失敗してもロボットにとって何も問題にならない——少なくとも、そのような引き受けが設計として十分に意図されてはいない。センサーはエラーを返す。モデルは更新される。誰かの存在への引き受けは、そのプロセスのどこにあるのか。

板金を運ぶことを学んだ機械が次に触れようとしているのは、記憶を持つ身体だ。

ニュースレターは無料で登録出来ます。

サポートメンバー限定記事は月に1、2本配信予定です。

脚注

[1] "With a shortage of 5.5 million nursing workers, 'electronic grandchildren' are starting work in nursing homes. How can elderly care robots support the later years of 300 million people?" 36Kr, June 26, 2025.

[2] 日本の介護施設ロボット導入率(2019年時点、全国約9,000施設対象):MIT Technology Review, "Inside Japan's long experiment in automating elder care," January 9, 2023. https://www.technologyreview.com/2023/01/09/1065135/japan-automating-eldercare-robots/

韓国の超高齢社会突入(2024年12月):Korea Herald, "South Korea now officially 'super-aged' society," December 24, 2024. https://www.koreaherald.com/article/10022641

[3] Figure AI, "F.02 Contributed to the Production of 30,000 Cars at BMW," November 2025.

BMW Group, "BMW Group to deploy humanoid robots in production in Germany for the first time," February 27, 2026. https://www.press.bmwgroup.com/global/article/detail/T0455864EN

[4] Jensen Huang(NVIDIAのCEO)、CES 2026基調講演、2026年1月5日。NVIDIA公式プレスリリース "NVIDIA Releases New Physical AI Models as Global Partners Unveil Next-Generation Robots."

[5] Amazon, "Amazon introduces Sparrow, a state-of-the-art robot that handles millions of diverse products," Amazon News, November 10, 2022.

[6] ノーバート・ウィーナー著、池原止戈夫・彌永昌吉・室賀三郎・戸田巌訳『ウィーナー サイバネティックス―動物と機械における制御と通信』岩波書店、1962年(岩波文庫、2011年)。

[7] William Grey Walter, "An Imitation of Life," Scientific American, Vol. 182, No. 5, 1950, pp. 42–45.

[8] Rodney A. Brooks, "Intelligence without Representation," Artificial Intelligence, Vol. 47, Issues 1–3, 1991, pp. 139–159.

[9] World Economic Forum, Physical AI: Powering the New Age of Industrial Operations, September 2025.

[10] モーリス・メルロ=ポンティ著、竹内芳郎・小木貞孝訳『知覚の現象学』みすず書房、1967年。

[11] フランシスコ・ヴァレラ、エヴァン・トンプソン、エレノア・ロッシュ著、田中靖夫訳『身体化された心―仏教思想からのエナクティブ・アプローチ』工作舎、2001年。

[12] Edmund Husserl, Ideas Pertaining to a Pure Phenomenology and to a Phenomenological Philosophy: Second Book, trans. R. Rojcewicz and A. Schuwer, Springer, 1989.

[13] ヒューバート・L・ドレイファス著、黒崎政男・村若修訳『コンピュータには何ができないか―哲学的人工知能批判』産業図書、1992年。

[14] Hubert L. Dreyfus, "Why Heideggerian AI Failed and How Fixing It Would Require Making It More Heideggerian," Philosophical Psychology, Vol. 20, No. 2, 2007, pp. 247–268.

原文:"we would have to include in our program a model of a body very much like ours with our needs, desires, pleasures, pains, ways of moving, cultural background, etc."

[15] John Haugeland, "Understanding Natural Language," Journal of Philosophy, Vol. 76, No. 11, 1979, pp. 619–632. 収録:Having Thought: Essays in the Metaphysics of Mind, Harvard University Press, 1998.

[16] Dimitri Coelho Mollo and Raphaël Millière, "The Vector Grounding Problem," arXiv:2304.01481, 2023.

記号接地問題の古典的定式化はStevan Harnad, "The Symbol Grounding Problem," Physica D, Vol. 42, 1990, pp. 335–346

[17] Igor Farkaš, Michal Vavrečka, and Stefan Wermter, "Will multimodal large language models ever achieve deep understanding of the world?" Frontiers in Systems Neuroscience, Vol. 19, 2025. https://doi.org/10.3389/fnsys.2025.1683133

[18] US Senate Health, Education, Labor and Pensions Committee (Chair: Sen. Bernie Sanders), The 'Injury-Productivity Trade-off': How Amazon's Obsession with Speed Creates Uniquely Dangerous Warehouses, December 2024. https://www.help.senate.gov/imo/media/doc/amazon_investigation.pdf

NPR, "Amazon manipulated injury data to make warehouses appear safer, a Senate probe finds," December 16, 2024.

[19] James Wright, Robots Won't Save Japan: An Ethnography of Eldercare Automation, ILR Press/Cornell University Press, 2023. 著者は英国アラン・チューリング研究所の人類学者。18ヶ月の現地調査に基づく。

[20] ILO, Global Estimates on International Migrant Workers, 4th edition, 2024.

すでに登録済みの方は こちら