「誤情報です」という誤情報——イラン攻撃、ディープフェイク、証拠性の崩壊

2026年3月15日、イスラエルのベンヤミン・ネタニヤフ首相名義の複数のSNSアカウントに動画が投稿された。カフェらしき場所。コーヒーを手に、カメラに向かって言う。「私が死んでるって?」。両手を広げてみせた。

どういうことか。

3日前に発端がある。3月12日の記者会見映像の0:35付近、手を上げた瞬間のフレームが切り取られて拡散した。「指が6本ある」。AIが生成した偽物だ、ネタニヤフはすでに死亡している。

米国のファクトチェックサイトSnopesは問題のフレームを「解剖学的」に検証した。「6本目」に見えたのは小指の付け根の膨らみ、つまりカメラ角度と影が作った錯覚だとされた[1]。AI検出ツールはAI生成確率0.1%と判定した[1]。米国の独立系ファクトチェック機関PolitiFact、米国のファクトチェックサイトLead Storiesなど複数の機関が同様の結論を出した[2]。

カフェの動画が投稿された後も、「あれもAIだ」という声は消えなかった。「コーヒーカップが傾いても溢れないのはおかしい(Coffeegate)」という新たな疑念が続いた[3]。否定の映像が、疑念の燃料になる。

米国の法学者ダニエル・シトロンとロバート・チェズニーはこの構造を「嘘つきの分け前(liar's dividend)」と名付けた[4]。ディープフェイクが広く知られると、本物の証拠を「フェイクだ」と言い張ることが容易になる。逆説的なことに、その「分け前」はディープフェイクについての教育が進むほど大きくなる。この構造は特定の陣営に限らない。ネタニヤフ陣営も、イラン政府も、米国政府も、それぞれの文脈でその余地を使いうる。Coffeegateはその典型のように見える。

ただし今回掘り下げたいのはCoffeegateそのものではない。その外側にある問いだ。

フェイクか否かという問いが機能しないとき

「フェイクかどうか」という問いが、問うべきことを隠すことがある。まずは、イラン陣営と米国・イスラエル陣営の非対称性、そして、検証不可能性な状況について以下で説明する。

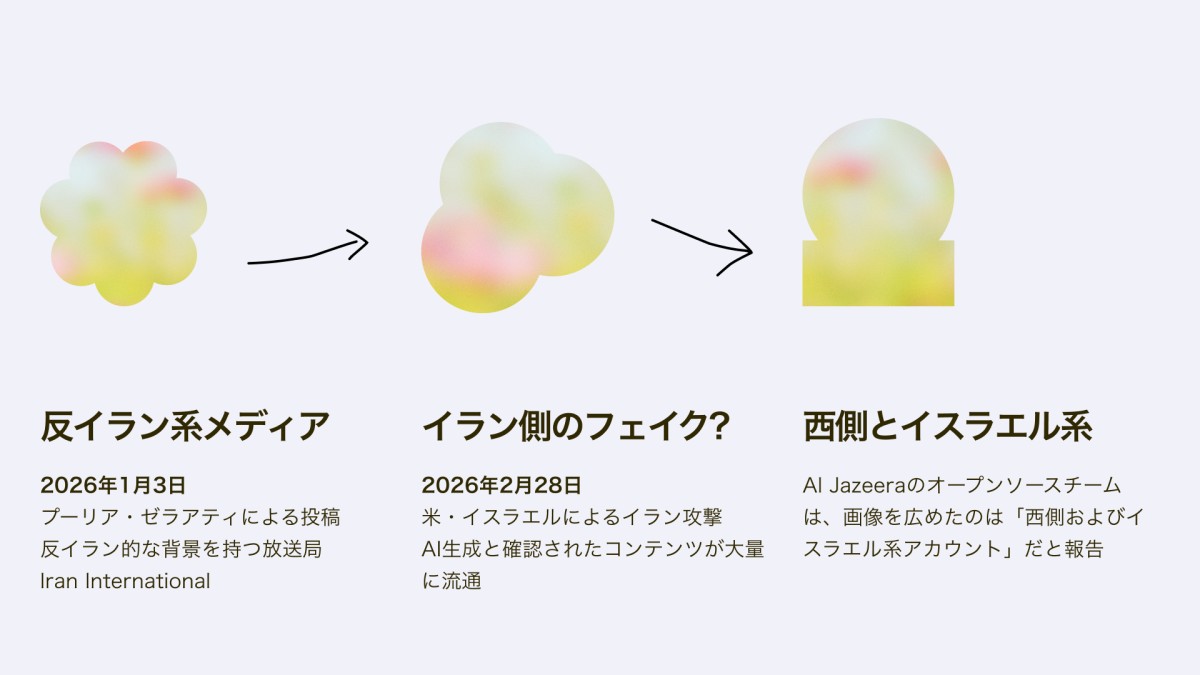

01.「イラン側のフェイク」というフェイク

2026年2月28日に始まった米・イスラエルによるイラン攻撃では、AI生成であると確認されたコンテンツが大量に流通した。イランの最高指導者アリー・ハメネイ師の「遺体」とされる画像にはGoogleの電子透かしSynthIDが検出された。AI生成だった[5]。米海軍の空母へのミサイル命中を主張する動画は、映っている艦船のデザインが実物と異なることが確認された。2025年以前から存在していた映像の流用だった[6]。

これらは「イラン側のフェイク」として流通した。しかしハメネイ師の遺体画像ひとつをとっても、それがどちらの陣営によるフェイクなのかは、二転三転した。

ハメネイ師の遺体画像は、攻撃の約2ヶ月前にすでに存在していた。2026年1月3日、Iran Internationalのジャーナリストが「最終計画」というキャプションをつけて投稿した画像がその起源だった。この放送局はロンドンを拠点とするペルシャ語のチャンネルで、イランに批判的な立場をとる[7]。Al Jazeeraのオープンソースチームは、画像を広めたのは「西側およびイスラエル系アカウント」だと報告している[7]。イランのウェブサイトに当該画像は存在しなかった。

「イラン側のフェイク」というフレーム自体が、フェイクだった可能性がある。

また、CNNは、捕虜になった米兵の映像やテルアビブへの爆撃映像など、イラン支持アカウントが広めたフェイクも複数記録している。「多くのフェイクの制作動機は特定困難。閲覧数や収益目的の可能性もある」とも指摘している[8]。今回、誰が何のために作ったかを確認することは、構造的に困難だった。独立した確認の回路が遮断されていたからだ。

02. 米国のプロパガンダ

一方、ペンタゴン、ホワイトハウス、米中央軍(CENTCOM)は、爆撃機やミサイルを「主役」にして死者の映像を含まない動画を制作・拡散した[9]。ホワイトハウスはビデオゲームの映像と国防総省の実際の映像を混合した動画をXに投稿した[10]。トロント大学シチズンラボは、イスラエル系のネットワーク「PRISONBREAK」がAI生成映像を実際の軍事攻撃と同期展開したことを記録している[11]。

同じ情報空間で、米国側の公式映像には「プロパガンダ」、イラン側のAI生成コンテンツには「フェイク」という呼称が使われた。CNNはこの非対称性を 「US propaganda vs. the emerging Iran war reality(米国のプロパガンダ vs 浮かび上がるイランの戦争の現実)」と題して分析している[9]。

03. 専門家の間でも判定が分かれる

この非対称な情報空間では、「フェイクかどうか」という問い自体が機能しなくなることがある。

2025年6月のエヴィン刑務所爆撃後、イスラエル外相はXに映像を投稿した。刑務所の入口が爆破される映像。「自由万歳!」というコメント付き。人権団体WITNESSの調査機関による分析は、この映像がAI生成の可能性が高いと判定した[12]。ただしBBC Verifyとカリフォルニア大学バークレー校のハニー・ファリド教授はAI生成の確証なしと結論しており、専門家間で判定が割れている。

実際の攻撃では周辺住民・面会中の家族・囚人が命を落とした。「ピンポイントでの爆撃のイメージ」がSNSで拡散されているさなか、現実の死はイメージの外側に置かれた。

似姿と蓋然性

ディープフェイクが変えたのは、情報の真偽ではない。証拠が証拠として機能する条件だ。

ネタニヤフの「遺体」画像は、何かを「偽造した」のではない。

ドイツの映像作家・思想家ヒト・シュタイエル(ベルリン芸術大学)は2023年の論文「Mean Images(ミーン・イメージズ)」でこう書く。機械学習が生成するイメージは、実在する対象と結びついたものではない。統計的なレンダリングだ。「似姿(likenesses)を蓋然性(likelihoods)に置き換える」[14]。簡単に言えば、「この人物はこう見えるはずだ」という確率の計算がイメージを生成する。見た目の記録ではなく、見た目の予測だ。

写真はフォトンがセンサーに当たったという物理的な痕跡だった。ある瞬間、ある場所で何かが起きたという因果的な証拠。AIが生成するイメージにその接続はない。ネタニヤフの「遺体」画像は「ネタニヤフが死亡した」という事実への参照ではなく、「戦時に指導者が敵に殺されたとしたら、こういう見た目になる」という確率の可視化だ。

Steyerl, H. (2023), "Mean Images," New Left Review, 140/141, pp.82–97.

SNS上には、ほぼ同時期に二者の「遺体」画像が流通した。ハメネイ師のものと、ネタニヤフのものだ。いずれもAI生成だった。ちがいは一つだけ——ハメネイは2月28日に実際に殺害された。ネタニヤフの死は確認できない。どちらのイメージも事実への参照ではなく蓋然性のレンダリングだ。一方は事実に偶然一致し、もう一方は偽りに偶然一致した。イメージの構造は同じで、現実との関係だけが異なる。

「フェイクか否か」という問いは、蓋然性のレンダリングには意味をなさない。

エヴィン刑務所の「ピンポイントでの精密な爆撃のイメージ」[13]はその逆に機能する。フェイクかもしれないが、フェイクであるかどうかに関わらず、クリーンで的確な攻撃のイメージが流布した瞬間、そこに映っていない死は見えにくくなる。巻き添え被害は、蓋然性の高いイメージとはなんの関係もなく、実際に起きた。

嘘つきの分け前、ハイパー冷笑主義、AIスロップ

フェイクが出る、拡散する、ファクトチェックされる。このサイクルが時間単位で回っている。追いついた頃には次のサイクルが始まっている。「フェイクが拡散した」という事実は消えない。

さらに今回の情報環境では、ファクトチェックツール自体が嘘つきの分け前を増幅した。デジタル法医学研究所DFRLabは、AI生成の爆撃映像一本へのGrokの回答を300件以上集計した[15]。Grokは「本物と思われる」と答えた数分後に「本物ではない可能性が高い」と答えていた。カナダの公共放送CBCがハメネイ師死亡記事に使った写真について、Grokが「AI生成」と誤回答し、CBCへの非難が約28万回拡散した[16]。米国のニュース信頼性評価機関NewsGuardは、GoogleのAI検索サマリーが偽情報映像を「真正」と確認するケースを複数記録した[17]。検証ツールが混乱の発生源になった。

この構造には先例がある。2023年10月のガザ侵略開始直後、ネタニヤフ首相の公式Xアカウントがハマスの攻撃による犠牲者の写真を投稿した。AI検出ツールがこれを「AI生成」と判定し、イスラエルが偽情報を流していると批判が殺到した。ツールは後に「画像は本物だった」と訂正したが、公式情報への不信感は残った[18]。一方で同時期、ガザの瓦礫の中の被害を描いたAI生成画像が数百万回拡散し、反イスラエルのデモの看板にも使われた[18]。どちら側も、本物とフェイクを使い分けながら相手のイメージを攻撃した。

この情報環境で、本物の映像がフェイクと誤認される逆転現象が起きた。イランのファクトチェック機関Factnamehが2025年6月の交戦時に記録したケースだ[19]。テヘランの通りでミサイルが着弾し車が宙を舞う映像は本物だったが、「AI生成だ」として大量に否定された。Factnamehはこれを「ハイパー冷笑主義(hyper-cynicism)」と呼ぶ。ディープフェイクが普及したことで、フェイクではない映像でさえ疑われる。

「AIスロップ」という言葉がある。slopは生ゴミや残飯という意味。AIが生み出す大量の低品質コンテンツが溢れていく現象のことだ。真実か偽物かという以前に、単に大量にある。判別不能なコンテンツが洪水のように流れ込む状態で、意味の解釈権が個人の手から遠ざかっていく。アルゴリズムが何を流通させるか、プラットフォームが何を検出するか、国家が何を遮断するか。「現実」はその交差点で構成される。フェイクかどうかを問い続けるとき、その問い自体がスロップの中に沈んでいく。

証拠が証拠として機能しなくなるとき

ここに今回まで続く構造がある。段階的に積み上げられてきた。

ウクライナ侵攻では「戦争そのものがフェイクだ」という否定が出た。ロシア側はブチャ・マリウポリの証拠映像を「捏造だ」「演出だ」と主張した。一部では「AIで偽造された」という言説も流通した。戦争の事実そのものが攻撃の対象になった。

ガザ虐殺ではその構造が変形した。攻撃の事実は否定されない。否定されるのは被害だ。カタールのノースウェスタン大学のメディア分析学准教授マーク・オーウェン・ジョーンズは、ガザにおける情報戦の構造を「alethocide(アレソサイド、真実の組織的破壊)」と呼ぶ[20]。民間人被害の記録が増えるにつれ、それを「偽旗(false flag)」「演出」として否定するキャンペーンが組織的に展開された。「Pallywood(パレスチナ人が苦境を演出しているというフレームの繰り返し)」だ。本物の被害の証拠が「フェイクかもしれない」という疑念にあらかじめさらされる環境が作られた。

そして、今回のイランでは、証拠が証拠として機能する条件そのものが崩れた。

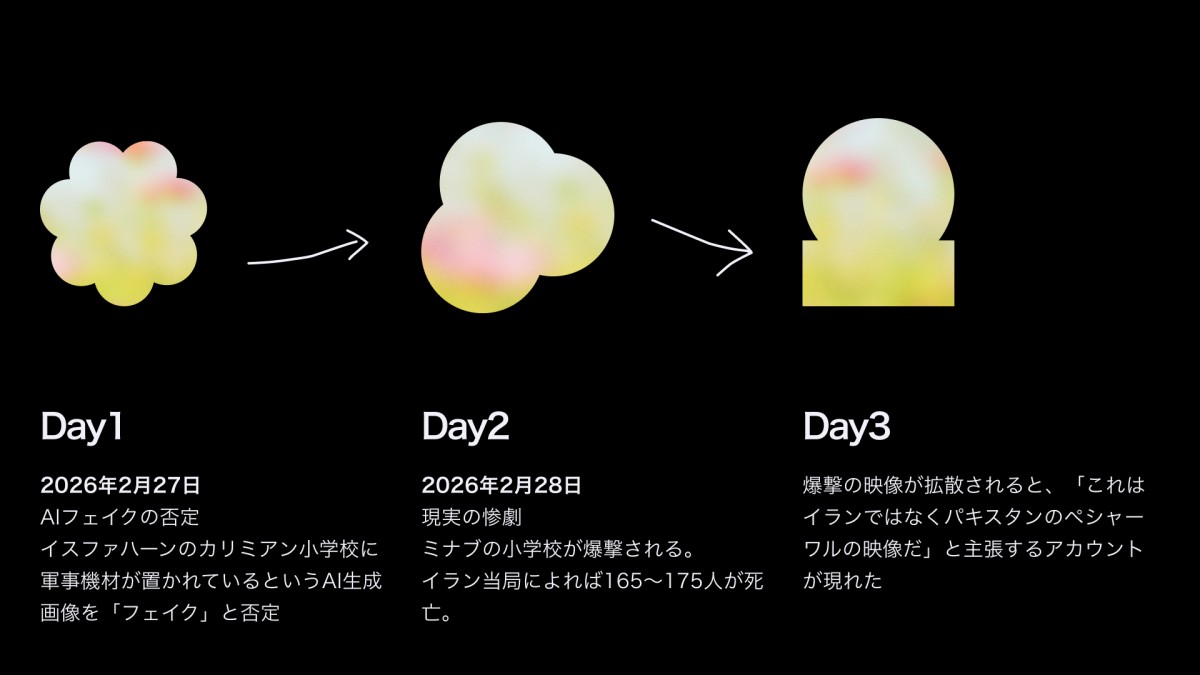

2026年2月27日、イスファハーンのカリミアン小学校に軍事機材が置かれているというAI生成画像が拡散した。GoogleのGeminiウォーターマークが検出され、ファクトチェッカーたちが否定した[21]。翌2月28日、南部ミナブのシャジャレ・タイエベ女子小学校が爆撃された。イラン当局によれば165〜175人が死亡した[22]。映像が流通すると、「これはイランではなくパキスタンのペシャーワルの映像だ」と主張するアカウントが現れた。前日にフェイクを否定した同じファクトチェッカーたちが、今度は本物を守るために動いた[21]。

フェイクを否定した実績が、本物への疑念を生む。ファクトチェックの蓄積が、不信の蓄積になった。

The Outpost, "AI Fakes Iran War: Misinformation Chaos Online," March 2026.

ウクライナで事実が、ガザで被害が、イランで証拠性そのものが。それぞれ違う層で、証拠が証拠として機能する条件が崩されてきた。ディープフェイクはその速度と規模を変えた。

この記事を書くあいだ、何度か自分の認識が変わった。「イラン側のフェイク」が「西側アカウントの拡散」になり、「本物」が「フェイク」になり、「フェイク」を否定した実績が「本物」への疑念を生んだ。

追うほど遠ざかる感覚があった。

現実が私たちの手元から離れていくのは、今回が初めてではない。ただ今回は、その速度と方向の数が違う、と感じている。

最後に、「検出ロジック」そのものへの懸念も、ここに記しておく。

AIが手の生成を苦手とするのは技術的な事実だが、「6本指=AI」という判定はその事実がSNS上で単純化していった言説にすぎない。実際の検出は複合的な手法に依拠している。「指が6本あればAIだ」という「判定」を成り立たせているのは、人間の身体には「正しい形」があるという前提だ。ヨーク大学社会学のベンジャミン・ジェイコブセンは、ディープフェイク検出アルゴリズムが「真か偽か」という二項対立に閉じ込められており、何を「人間的」とみなし何を排除するかという問いを覆い隠すと指摘した[23]。テキサス大学ダラス校のジンシウ・レベッカ・ハンとアン・バルサモは、生成AIが身体の「標準的な形」から外れる表現をエラーとして扱う構造は社会に根付いた身体規範を強化すると論じた[24]。

多指症(polydactyly)は、たとえば日本では1,000〜2,000人に1人の割合で生まれる実在の形態的な差異だ[25]。「6本指=AI生成の証拠」という単純化された言説は、実際に6本指を持つ人物の本物の写真を系統的にフェイク扱いするリスクを内包している。身体の多様性を「エラー」と解釈する価値観が、何が「本物」で何が「偽物」かを決める権力を持つことを、私は望まない。

ニュースレターは無料で登録出来ます。

サポートメンバー限定記事は月に1、2本配信予定です。

脚注

[1] Snopes, "Video doesn't show Netanyahu with 6 fingers per hand, isn't AI," March 12, 2026.

AI検出ツールはaiornot.comを使用。同サービスは検出ツールを販売する商業サービスであり、独立した研究機関ではない点に留意。

[2] PolitiFact, "No, Netanyahu didn't have six fingers during his press conference," March 13, 2026.

Lead Stories, "Fact Check: Video Does NOT Show Netanyahu With Six Fingers On His Right Hand -- It's Just A Shadow On His Palm," March 2026.

すべての検証の一次ソースはGPOの映像に収斂する。

[3] Infowars, "Coffeegate," March 15, 2026.

Alex Jonesが運営するサイト。信頼性は低い。「Coffeegate」という名称はXアカウント@ShadowofEzraが3月15日に使い始め、広まった。Infowarsはこの名称を記事タイトルに採用した側。

[4] Citron, D.K. and Chesney, R. (2019), "Deep Fakes: A Looming Challenge for Privacy, Democracy, and National Security," California Law Review, 107(6), pp.1753–1820.

[5] 日本ファクトチェックセンター(JFC)、「イランの戦争をめぐるAIディープフェイクの大量拡散/JFC記事・動画や関連記事【今週のファクトチェック】」、2026年3月7日。

[6] PolitiFact, "These videos don't show US strikes in Iran and counterattacks, they're AI and outdated," March 2, 2026.

USS Abraham Lincolnの艦船デザイン比較はAP通信の写真との照合によるらしい。

[7] Soch Fact Check, "None of these images actually show Iran Supreme Leader Ali Khamenei dead body," March 2026.

リバースイメージ検索でPouria Zeraatiの1月3日投稿が起源と判明。Al Jazeeraオープンソースチームの「西側およびイスラエル系アカウントが広く拡散した」との報告も同記事経由で確認。

[8] CNN, "Fake, AI-generated images and videos of the Iran war are spreading on social media," March 11, 2026.

イラン支持アカウントが広めたフェイクの記録、および「多くのフェイクの制作動機は特定困難」という指摘を含む。

[9] CNN, "Analysis: 'Boom Boom' US propaganda vs. the emerging Iran war reality," March 12, 2026.

Fred Pleitgen記者はイラン政府の許可のもとで現地取材を行っているらしい。

[10] The Hill, "Fake Iran images show AI used as a weapon of 'public opinion,' USF experts say," March 2026.

USF犯罪学准教授Jordan Howellによる指摘。ホワイトハウスがビデオゲームと国防総省の映像を混合した件も同記事で言及。

[11] Erkan's Field Diary, "Disinformation in the Iran-Israel-US War: Major Cases and Patterns as of 6 March 2026," March 6, 2026. https://erkansaka.net/2026/03/06/iran-war-disinformation-ai-2026-6-march/

本記事はAFP、Reuters、BBC Verify、NewsGuard、PolitiFact等の一次報道を集約したもの。シチズンラボのPRISSONBREAKキャンペーン調査、DFRLabのGrok検証記録(300件超)、X社のクリエイター収益停止方針など複数の一次報告を引用。

[12] Alimardani, M. and Gregory, S. (2025), "Iran-Israel AI War Propaganda Is a Warning to the World," Carnegie Endowment for International Peace, July 28, 2025.

WITNESSはDeepfakes Rapid Response Force(DRRF)を通じてエヴィン刑務所映像を分析した。分析は対象期間が2025年6月であり、2026年2月28日以降の現在進行中の攻撃ではない。なおエヴィンの映像については複数の専門家間で判定が割れており、BBC VerifyとHany Farid教授は「AI生成の確証なし」と結論。WITNESSは「AI生成の可能性が高い」とした。

[13] 「精密な攻撃(precision attack)」という表現はイスラエル国防省の発表を引用した複数のメディアで使われたもよう。

例:Organiser, "Israel's bombing of Evin Prison," June 24, 2025.

なお、この攻撃でイラン側は79人の死亡を発表しており、Amnesty InternationalおよびHuman Rights Watchは国際人道法違反にあたると声明を出している。

[14] Steyerl, H. (2023), "Mean Images," New Left Review, 140/141, pp.82–97. https://newleftreview.org/issues/ii140/articles/hito-steyerl-mean-images

「似姿(likenesses)を蓋然性(likelihoods)に置き換える」は筆者訳。

原文: "They replace likenesses with likelihoods."

タイトルの "mean" は英語の多義性を意図的に利用している。「平均」「卑しい/低い」「意地悪な」「手段」という意味が同時に機能する。機械学習が生成する画像は、これらすべての意味において "mean" である、というのが論文全体の主張。

[15] DFRLabの集計はErkan's Field Diary(前掲[11])が引用。Atlantic Council DFRLabはAtlantic Councilというシンクタンクの傘下機関。同シンクタンクは米国外交政策寄りの性格を持つようだ。

[16]「イラン攻撃で「AIフェイク動画・画像」「AI誤回答」が氾濫、「AIゴミ」が歪める戦争」、Yahoo!ニュース エキスパート、2026年3月9日。https://news.yahoo.co.jp/expert/articles/31bf7f3ef199f6c19026471759012ccddd4a04b9

CBC/Grok誤回答については以下も参照。

AFP Canada Fact Check, "Canadian broadcaster did not publish AI-generated image after Khamenei's death," March 5, 2026. https://mediaconnect.com/canadian-broadcaster-did-not-publish-ai-generated-image-after-khameneis-death

[17] AL-Monitor, "'Narrative war': disinformation surges as conflict roils Middle East," March 2026.

NewsGuardはニュース信頼性評価の商業サービス。

[18] ガザのAI生成コンテンツについては二つの事例を参照。

ネタニヤフ公式アカウントの写真とAI検出ツールの誤判定については、以下。

INSS Insight No.1779, "Deep Fake in Swords of Iron: A Battle for Public Opinion," November 5, 2023.

AI生成の乳児画像の拡散については以下。

AP, "Fake babies, real horror: Deepfakes from the Gaza war increase fears about AI's power to mislead," November 2023.

[19] Factnameh/EDMO, "The First AI War: How the Iran-Israel Conflict Became a Battlefield for Generative Misinformation," 2025. https://edmo.eu/publications/the-first-ai-war-how-the-iran-israel-conflict-became-a-battlefield-for-generative-misinformation/

Factnamehは2017年創設のイランのファクトチェック組織。EDMOは欧州メディア観測機関。「ハイパー冷笑主義(hyper-cynicism)」はFactnamehの造語。

[20] Jones, M.O. (2025), "Evidencing alethocide: Israel's war on truth in Gaza," Third World Quarterly, pp.1–18. https://doi.org/10.1080/01436597.2025.2462791

ジョーンズはカタールのノースウェスタン大学のメディア分析学准教授。「alethocide」は真実の組織的破壊を意味する造語。「Pallywood」フレームの分析もこの論文から。

[21] The Outpost, "AI Fakes Iran War: Misinformation Chaos Online," March 2026.

カリミアン小学校のAI生成画像(Geminiウォーターマーク確認)とミナブ映像への「ペシャワル映像」という誤情報拡散の両事例を記録。

[22] ミナブ女子小学校の死者数については複数の報道・機関が確認。

Al Jazeera, "Death toll in Israeli strike on southern Iran school rises to 165," February 28, 2026.

UNICEF報告は168人(2026年3月5日)。イラン当局発表は175〜180人。

Human Rights Watch, "US/Israel: Investigate Iran School Attack as a War Crime," March 7, 2026.

[23] Jacobsen, B.N. (2025), "Deepfakes and the promise of algorithmic detectability," European Journal of Cultural Studies, 28(2), pp.419–435.

[24] Han, J.R. and Balsamo, A. (2025), "The normative body and 'stupid AI': challenging compulsory able-bodiedness in human-AI interaction," Proceedings of the Design Society, Volume 5: ICED25, pp.3061–3069.

[25] 多指症の発生頻度については、慶応義塾大学病院KOMPAS「多指症」https://kompas.hosp.keio.ac.jp/disease/000125/ を参照。

日本では1,000〜2,000人に1人とされる。国によって微妙に違いそう。国際的な数字については 以下を参照。

Agarwal, A. et al., "A review of polydactyly and its inheritance," Medicine, 101(50), 2022. https://pmc.ncbi.nlm.nih.gov/articles/PMC9771235/

すでに登録済みの方は こちら