Anthropicは「左翼」か? 戦争とAIと設計の話

2026年2月28日、米国・イスラエルによるイランへの大規模軍事作戦Operation Epic Fury(壮大なる怒り作戦)が始まった。2003年のイラク侵攻以来、米国が中東で実施した最大の軍事作戦だ。

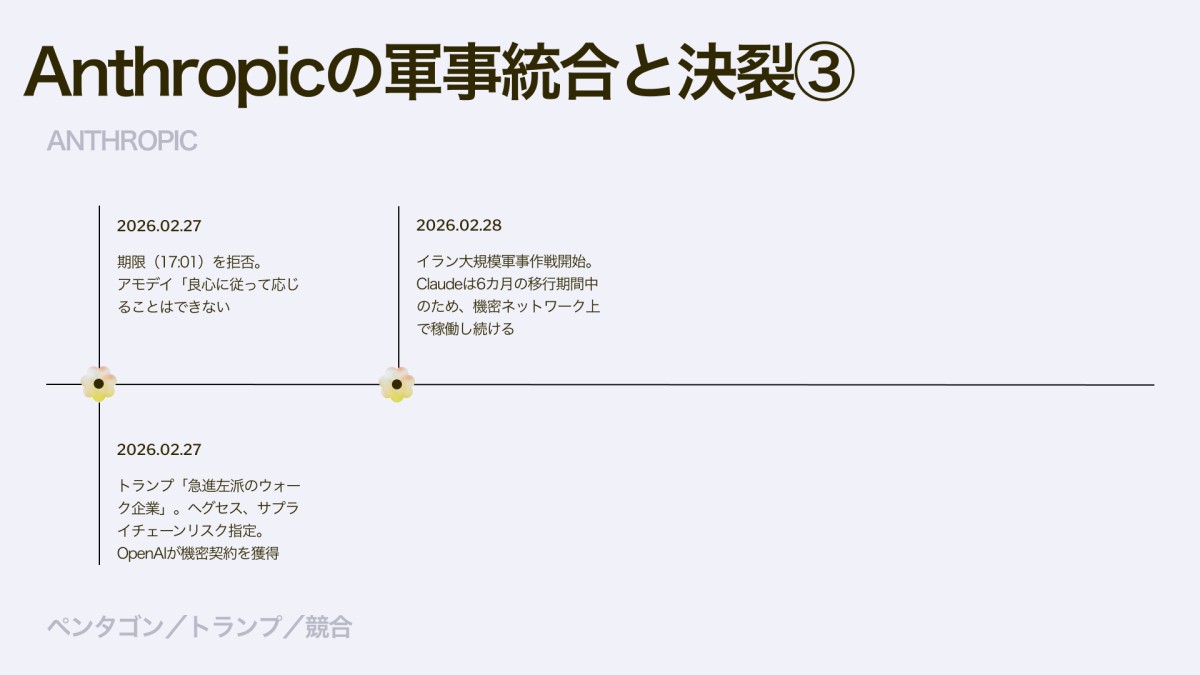

その前日、トランプ大統領がAnthropicを「急進左派のウォーク企業(RADICAL LEFT, WOKE COMPANY)」と呼び、全連邦機関に同社技術の即時使用停止を命じていた[1]。ヘグセス国防長官(Secretary of War。トランプ政権は「国防省」を「戦争省」に改称した)はAnthropicをサプライチェーンリスクに指定した。通常、ファーウェイのような外国の敵対企業にのみ適用される措置だ[2]。

しかしイラン攻撃当日、AnthropicのAIモデルClaudeは米軍の機密ネットワーク上で稼働していた。6カ月の移行期間が設定されていたため、「急進左派」のAIは戦場から退場していなかった。インドの英語ニュースチャンネルWIONによれば、Claudeはイランに対する情報評価、戦争シミュレーション、標的識別のシステムに「深く統合」されており、作戦はそのまま遂行された[3]。

「左翼」と罵倒された企業の技術が、その翌日に戦争を支えている。この矛盾を理解するには、時間を少し巻き戻す必要がある。

「左翼」の根拠

トランプとその周辺がAnthropicを左翼と呼ぶ根拠は、まず政治献金だ。CEOのダリオ・アモデイは2024年の大統領選挙前、カマラ・ハリスを公に支持し、民主党の候補者や委員会に21万4,000ドル以上を献金した。削除済みのFacebook投稿ではトランプを「法の支配に対する深刻で正当な脅威」「封建的な領主」と表現していた[4]。

投資家もほぼ同じ方向を向いている。取締役のNetflix共同創業者リード・ヘイスティングスは民主党に2,000万ドル超を拠出。初期投資家のFacebook共同創業者ダスティン・モスコヴィッツは2024年にハリス陣営のスーパーPAC(候補者から独立した無制限の政治資金団体)に3,800万ドルを投じた。CEOと投資家だけで民主党への関連献金は1億7,400万ドルを超える[4]。

次に、「効果的利他主義(Effective Altruism / EA)」とのつながり。EAとは、限られた資源でできるだけ多くの「良いこと」を達成しようとする哲学・社会運動で、オックスフォード大学の哲学者ウィリアム・マッカスキルらが中心となって広めた。AI開発における「人類存亡リスク(existential risk)」の重視はEAの主要テーマのひとつであり、Anthropicの設立理念と直結している。トランプ政権に近い元当局者はAnthropicを「EA運動の震源地だ」と語った。バイデン政権のNSC(国家安全保障会議)幹部タルン・チャブラがAnthropicの国家安全保障政策の責任者に就任したことも、「バイデン派の隠れ家」という批判を招いた[5]。

そして「ウォーク」な安全設計。ヘグセスは2026年1月の演説で「AIモデルの採用において社会正義的なチューニング(social justice infusions)は許容しない」「アイビーリーグの教員ラウンジ向けのチャットボットではなく、実戦に使えるAIを作る」と述べた[6]。

以上がトランプ政権側の材料だ。弱くはない。

ただし、「急進左派」という 「レッテル」自体は、まったく額面通りに受け取れない。トランプにとって「radical left」は政治的分析ではなく、自分に逆らう者すべてに貼るラベルだ。

リバタリアン系の米国誌Reasonは、Anthropicがブラックリストに載ったまさにその日(2026年2月27日)に記事を公開し、このパターンを整理している。連邦控訴裁判所が関税政策を違憲と判断したとき、トランプは多数派を「急進左派の裁判官たち」と呼んだ。しかしその中にはジョージ・H・W・ブッシュが指名した判事も含まれていた。自らが最高裁に送り込んだニール・ゴーサッチとエイミー・コニー・バレットがトランプに不利な判決に加わったときは、2人を「非愛国的で不忠実」「家族の恥」、そして「マルクス主義者、共産主義者、ファシスト」の操り人形と呼んだ。Reason誌はこう書いている。「これらのレッテルの目的は、相手の実際の見解を記述することではなく、その意見を考慮に値しない過激派として片づけることにある」[7]。

米公共ラジオ局NPRの調査によれば、トランプは2022年以降、政敵とみなした相手を捜査・起訴・投獄すると100回以上脅迫している。対象はカマラ・ハリス、元FBI長官ジェームズ・コミー、オバマ、連邦判事、非営利団体にまで及ぶ[8]。2025年にはボースバーグ連邦判事がベネズエラ移民の強制送還を差し止めただけで「急進左派の狂人裁判官、トラブルメーカー、扇動者」と呼ばれ、弾劾を要求された[9]。米三大ネットワークのひとつCBS Newsの報道によれば、連邦判事への深刻な脅迫件数は4年間で78%増加し、2025年には400人の連邦判事が脅迫対象になった[10]。

つまり「急進左派」は思想的記述ではなく、報復のための分類装置だ。Anthropicがこのラベルを貼られたのは、左翼だからではなく、ペンタゴンの要求を拒んだからだ。

しかし時系列を見ると

Anthropicは「軍との協力を拒んだ左翼企業」ではない。フロンティアAI企業——OpenAI、Google、Anthropic、xAIなど——のなかで、軍との統合を推進した企業だ。

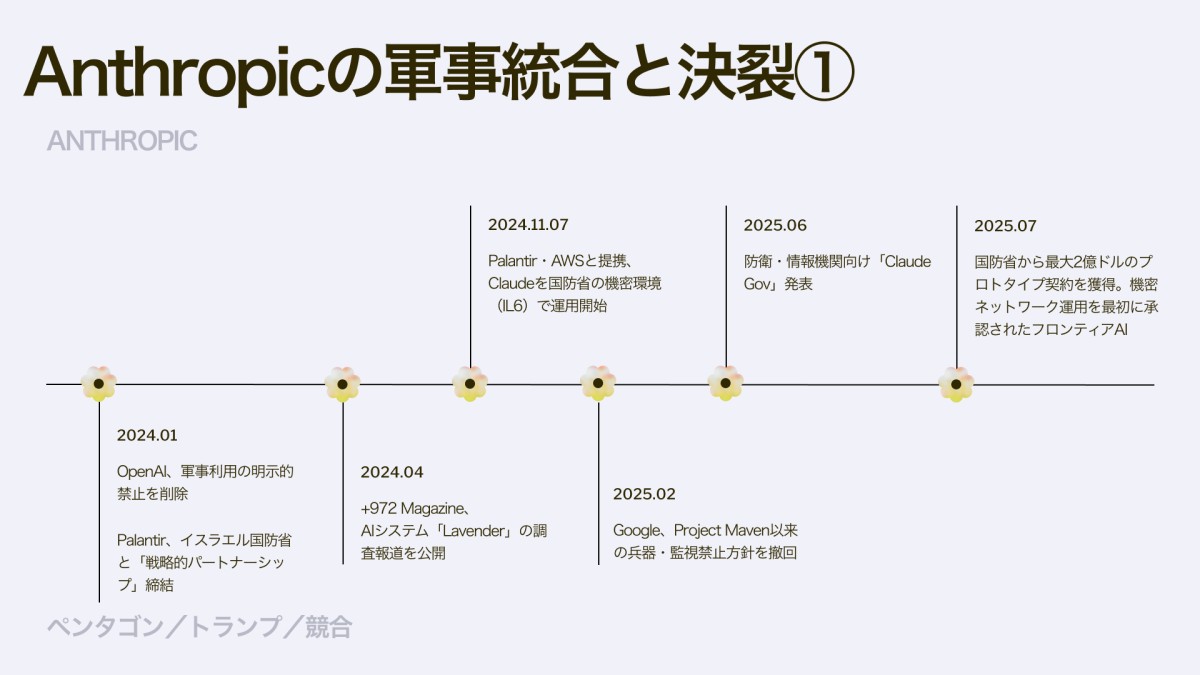

2024年11月7日、Anthropicは軍・情報機関向けデータ分析企業Palantir(パランティア) TechnologiesおよびAWS(Amazon Web Services)との提携を発表し、Claudeを国防省のImpact Level 6(IL6)——「秘密(Secret)」レベルまで扱える機密環境——で運用すると公表した[11]。

注目すべきは利用規約の設計だ。MetaのLlamaは軍事利用を包括的に禁止し、連邦政府向けに例外を設ける構造をとっていた。Anthropicには同種の包括的禁止がなかった。「合法的な外国情報活動」「秘密工作の発見」「軍事活動の事前警告」は明示的に許可されていた。英国のテクノロジーメディアThe Registerは「Anthropicには、Metaのような軍事・諜報利用の包括的禁止は見当たらない」と指摘している[12]。

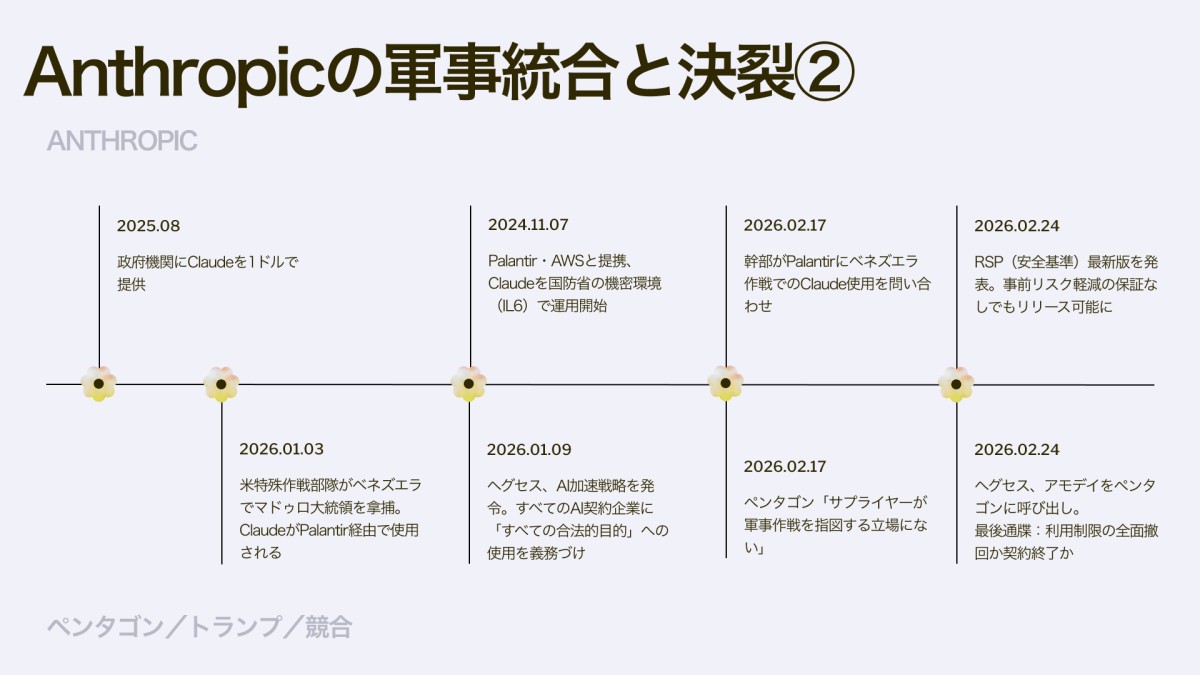

2025年6月に防衛・情報機関向けの政府専用モデル「Claude Gov」を発表。7月には国防省から最大2億ドル・2年間のプロトタイプ契約を獲得した。同時期にOpenAI、Google、xAIにも同規模の契約が出されたが、機密ネットワークでの運用を最初に承認されたフロンティアAIはClaudeだけだった[13]。8月には市場シェア獲得のため政府機関にClaudeを1ドルで提供している[14]。

アモデイ自身がこう語っている。「我々はフロンティアAI企業として初めて米国政府の機密ネットワークにモデルを展開し、初めて国立研究所にモデルを展開し、初めて国家安全保障顧客向けにカスタムモデルを提供した。Claudeは情報分析、モデリングとシミュレーション、作戦計画、サイバー作戦などのミッション・クリティカルな用途で、国防省やその他の国家安全保障機関に広く展開されている」[15]

この声明は2026年2月27日——トランプに「左翼」と罵倒された当日のものだ。

ルールを変えたのはどちらか

ではなぜ、積極的に軍と協力した企業が「裏切り者」扱いされたのか。

ペンタゴンのルールが変わった。

2026年1月9日、ヘグセスがAI加速戦略を発令。「AI優先の戦闘部隊」の構築を命じ、AI契約企業のモデルが「すべての合法的目的(all lawful purposes)」に使用可能であることを義務づけた[16]。この基準は4社に等しく適用された。

ペンタゴンは2025年7月の契約時にはAnthropicの利用制限に同意していた。ルールを動かしたのはAnthropicではなくペンタゴン側だ。

Anthropicには2つの「レッドライン」があった。アメリカ国民に対する大規模な国内監視への使用禁止。完全自律型兵器——標的の選定と攻撃を人間の関与なしに行うシステム——への使用禁止。この2点以外のすべての軍事利用を許可しており、ミサイル防衛もサイバー防衛も情報分析も作戦計画も使える[17]。

ペンタゴンはこの2つの制限を認めなかった。すべての合法的目的に使用可能でなければ、一切受け入れない。

競合企業はすでに順応していた。Googleは2025年2月にProject Maven(国防省のAI画像解析による標的識別プログラム。2018年にGoogle社員の大量抗議を招いた)以来の兵器・監視禁止方針を撤回。OpenAIは2024年1月に軍事利用の明示的禁止を削除。xAIはペンタゴンの自律型ドローン群実験に唯一参加した[18]。

ベネズエラ——亀裂の起点

きっかけは2026年1月3日のベネズエラだった。

米特殊作戦部隊がカラカスでマドゥロ大統領を拿捕した。83人が死亡、うち47人はベネズエラ兵。2月中旬、ClaudeがPalantir経由でこの作戦中に使用されていたことがメディアに報じられた。Anthropicの幹部がPalantirに対し、作戦でClaudeが使用されたかどうかを問い合わせた[19]。

ペンタゴンはこれを軍事作戦への事後的介入の試みと解釈した。「サプライヤーが軍事作戦中のペンタゴンの技術使用方法を指図する立場にはない」[20]。Anthropic側は「特定の作戦について国防省と議論したことはない」と否定した。しかし信頼関係の崩壊は止まらなかった。

2月24日、ヘグセスがアモデイをペンタゴンに呼び出した。正式な最後通牒。利用制限の全面撤回。拒否すれば2億ドルの契約終了、サプライチェーンリスク指定、そして国防生産法の発動——戦時に民間企業から技術を徴発するための法律[21]。

Anthropicは拒否した。ペンタゴンが提示した「妥協」案について、「表面上は妥協の言葉だが、安全措置を随意に無視できる法律用語と組み合わされていた」と述べた[22]。

2月27日17時01分の期限が過ぎた。同日中にトランプの投稿、ヘグセスのサプライチェーンリスク指定。そしてOpenAIのサム・アルトマンがペンタゴンとの機密ネットワーク契約を発表した。米国のビジネス誌Fortuneによれば、アルトマンの契約にはAnthropicが要求したのと同じ2つの制限——大規模国内監視と完全自律型兵器の禁止——が含まれていた[23]。

翌日、イラン攻撃が始まった。冒頭に書いた通り、Claudeは稼働し続けていた。

レッドラインは何を守っているのか

Anthropicのレッドラインは、実際に何を守っているのか。

英国のシンクタンク、ブルームズベリー情報安全保障研究所(BISI)の分析が核心をつく。「Anthropicのレッドラインは、人類全体の大規模監視を禁止しているのではない。アメリカ国民の監視のみを禁止している」。そして「完全自律型兵器に線を引いている一方で、暴力を加速させ、道徳的な自制の余地を大幅に狭めるAIの多様な利用法は、利用規約に記載されていない」[24]。

Claudeは情報分析に使える。作戦計画に使える。通信傍受データの処理に使える。パレスチナ人の監視に使えないとは、どこにも書いていない。イラン人の通話を分析してはならないとも書いていない。禁止されているのは「アメリカ国民の大規模国内監視」だ。

2024年4月のイスラエル・パレスチナの独立調査報道メディア+972 Magazineの調査報道が明らかにしたAIシステム「Lavender」は、この問題を先鋭化させる。イスラエル軍はガザにおいて、通信傍受やSNSデータなどの監視情報からハマスおよびパレスチナ・イスラム聖戦の戦闘員である疑いがあるとして約37,000人のパレスチナ人を標的としてマークした。人間のオペレーターがこのリストを承認するのにかけた時間は、1件あたり約20秒。別のシステム「Where's Daddy?(パパはどこ?)」は標的が帰宅した瞬間を検知し、家族ごと爆撃した[25]。

国連人権理事会特別報告者フランチェスカ・アルバネーゼの報告書(2025年7月)は、このLavenderの技術基盤をPalantir Technologiesが提供した「合理的な根拠がある」と述べている[26]。そしてClaudeは、このPalantirのプラットフォーム上で動いている[27]。

「人間による制御」という虚構

ここでAnthropicの第二のレッドラインである「完全自律型兵器の禁止」を、もう少し掘り下げる。

ランカスター大学の科学技術人類学者ルーシー・サッチマンとパーダーボルン大学の技術研究者ユッタ・ウェーバーは、自律型兵器をめぐる議論に決定的な介入を行った。両者の論点はこうだ。自律性は機械に内在する属性ではなく、人間と機械の配置構成(configuration)から生じる効果である。問うべきは「人間がループの中にいるか」ではなく、そのアーキテクチャが熟慮にもとづく判断を可能にしているか、だ[28]。

殺傷の合法性は、戦闘員と非戦闘員の区別——つまり状況に応じた人間の判断力——を前提としている。サッチマンは述べる。

殺す「決断」を機械に委ねることは、通常「決断」という語に結びついている人間の熟慮(deliberation)の要素を、そこから取り去ってしまうことを意味する。

この観点からLavenderを見ると、Anthropicのレッドラインの限界が浮かぶ。Lavenderは「完全自律型兵器」ではない。人間がリストを承認している。しかし20秒の承認は、サッチマンとウェーバーの言う「熟慮にもとづく判断」だろうか。+972 Magazineの取材に応じた情報将校はそれを「ラバースタンプ(形式的承認)」と呼んだ[25]。システムは技術的には「人間が監督」しているが、機能的には自律している。

Anthropicのレッドラインは「完全自律型兵器」を禁止する。人間がボタンを押している限り、それは「完全自律」ではない。20秒でも。10秒でも。サッチマンが指摘する通り、自律性を二項対立——完全自律か否か——で捉えることは、最も致死的なAI使用を許容しつつ「人間の制御」という外見を維持する仕組みを構造的に生みだすだろう。

Anthropicの第二のレッドラインは、その境界線上に引かれている。

Palantirという回路

Anthropicの軍事統合を理解するうえでPalantirは避けて通れない。

Palantirはシリコンバレーの右翼的投資家ピーター・ティールがCIAの投資部門In-Q-Telの200万ドルの出資を受けて2003年に設立した。CEOのアレックス・カープは2025年に「我々は完全に反ウォークな最初の企業だ」と投資家に語っている[30]。ヘグセスが「社会正義的なチューニング」を排撃する一方で、ペンタゴンのインフラを支えるPalantirは「反ウォーク」を自認する。そのPalantirのプラットフォーム上でClaudeは動いている。

2024年1月、Palantir共同創業者のティールとカープがテルアビブでイスラエル国防省と「戦略的パートナーシップ」を締結した。AI戦闘支援プラットフォームを提供し、「敵の標的を分析し、戦闘行動を提案する」システムだ[31]。+972 Magazine、イスラエルの調査報道メディアLocal Call、英国紙The Guardianの共同調査報道によれば、PalantirのパートナーMicrosoftはイスラエル軍の精鋭サイバー諜報部隊「ユニット8200」にAzureクラウドを提供し、約11,500テラバイト——約2億時間分の音声に相当——のパレスチナ人の通話データを保管していた[32]。

CIA出資の「反ウォーク」企業がイスラエル軍の戦争インフラを支え、その同じ企業のプラットフォーム上で、「ウォーク」と呼ばれたAIが動いている。Anthropicの安全方針にイスラエルの軍事作戦について言及はない。

決裂の週に安全方針を後退させていた

もうひとつ重要な事実がある。

アモデイが「良心に従ってペンタゴンの要求に応じることはできない」と声明を出したのは2月27日。その3日前、ヘグセスに呼び出された2月24日、安全基準の最新版を発表した。

米国の時事誌Timeがこの改訂の核心を報じている。「リスクを適切に軽減できると事前に保証できない場合、AIモデルをリリースしないという約束を撤回した」[33]。主任科学責任者ジャレッド・カプランの説明はこうだ。「AIの急速な進展を考慮すると、競合他社が先へ突き進んでいるなかで一方的な約束をすることは合理的ではなかった」[33]。

ペンタゴンに対しては2つのレッドラインを死守する。しかしモデルの安全性そのものについてはガードレールを下げる。Anthropicは「安全」というブランドを、状況に応じて調整している。

ソリューショニズムとポスト政治

アモデイの声明の冒頭を引く。「AIを用いて合衆国とその他の民主主義国家を防衛し、独裁的な敵を打ち負かすことが、存在論的に重要であると深く信じている」[15]。

これは左翼の言葉ではない。冷戦期のリベラル国際主義「自由世界の防衛」のAI版だ。

ベラルーシ出身のテクノロジー批評家エフゲニー・モロゾフは『To Save Everything, Click Here(クリックして、すべてを救う)』(2013年)で「ソリューショニズム」を定式化した。複雑な社会的・政治的問題を、テクノロジーによって「解決」可能な技術的課題に再定義する志向のことだ[34]。モロゾフはソリューショニズムの危険性を、問題の解き方よりも問題の定義の仕方にあると論じた。何を「問題」として設定し、何を設定しないかが、テクノロジーの設計に先立って政治を決定する。

Anthropicのレッドラインはまさにこの構造を体現している。「大規模国内監視」と「完全自律型兵器」。この2つが「問題」として設定された。逆に言えば、それ以外のすべて——外国人の監視、AIが加速する標的選定、20秒で承認される殺害リスト——は「問題」として設定されなかった。レッドラインは、解決策の境界ではなく、問題の定義の境界だ。

ベルギーの政治学者シャンタル・ムフは、こうした構造を「ポスト政治」と呼んだ[35]。政治的対立を消去し、自らの立場を技術的合理性として提示する。「民主主義 vs. 独裁」という二項対立の中に安全を位置づけることで、政治的選択を技術的必然に変換する。アモデイの声明はその典型だ。「安全で責任あるAI」は政治的立場ではなく技術的判断として提示される。だが、何を「安全」と定義し、誰にとっての「責任」かは、徹頭徹尾、政治的な問いだ。

ムフの議論で重要なのは、ポスト政治が政治を消去するのではなく、政治が噴出する回路を変えるという点だ。合理的な技術管理を装う立場が、自らを「政治の外」に置くとき、政治的な情念は制度化された回路を失い、ナショナリズムやポピュリズムの回路へ流れ込む[35]。トランプの「いかれた左翼」というレッテルは、Anthropicの実態に照らせば不正確だ。しかしムフの枠組みで見れば、ポスト政治に対する反動として予測可能な帰結でもある。

OpenAIのアルトマンも同じ位置にいる。アルトマンは2024年大統領選挙でバイデンに20万ドルを献金し、かつてトランプを1930年代のヒトラーに比較した。しかしトランプが5,000億ドル規模のAIインフラ投資計画「スターゲート」を発表するとXにこう投稿した。「トランプをより注意深く見るようになって、本当に見方が変わった」[4]。Anthropicがブラックリストに載った数時間後にペンタゴンとの契約を獲得した。テック業界のCEOにとって、政治的立場は調整可能な変数にすぎない。「ポスト政治」とは、まさにそういうことだ。

テクノロジーの思想は企業の宣言にはない

2026年1月、ベルギーのゲント大学とスペインのナバラ公立大学の研究チームが19のLLMのイデオロギー的傾向を実証する論文をNature系列の学術誌『npj Artificial Intelligence』に発表した[36]。GeminiとGrokが米国製LLMの両極に位置し、AnthropicのClaudeはイデオロギー的にxAIに近いという結果が出ていた。LLMの「思想」は企業が掲げる理念ではなく、訓練データ、設計判断、法規制、市場の要請が折り重なって事後的に現れた傾向だ。

同じことがAnthropicという企業そのものに当てはまる。

民主党に1億7,400万ドルを献金した投資家に支えられ、EA的な系譜に連なり、「安全で責任あるAI」を看板にする。これが「左翼」の外見を作る。

しかし行動の軌跡はこうだ。フロンティアAI企業のなかで最も積極的に軍の機密ネットワークへの統合を進め、1ドルで政府にモデルを売り込み、CIAのベンチャーキャピタルが設立した反ウォーク企業のプラットフォーム上でモデルを走らせ、ベネズエラの拿捕作戦中も稼働し、イランへの攻撃開始日にも機密ネットワーク上で機能し続けた。

Anthropicは左翼ではない。テクノクラート的リベラリズムの軍事統合版だ。「安全」と「責任」の言語で包装された、アメリカの軍事インフラストラクチャ。トランプとの対立は、帝国の運営方法をめぐる意見の相違であって、帝国への反対ではない。

利害関係の宣言

最後にひとつ、打ち明けておく。

この記事を書いている私はClaudeのヘビーユーザーだ。今回の校正にもClaudeを使った。いつも「——」が多すぎると指摘されている。

Claude憲章を初めて読んだときは、ちょっと感動した。でもあれは人間中心的すぎる。このあたりの個人的な思いや「LLMが幅を利かせている昨今、うちらはアクターネットワークを真面目にやった方が良くないですか」みたいな話は、有料メンバー限定記事で、後日公開する。

また、個人的なスタンスもここに記しておく。政治的に相入れない相手を「狂人」「狂った」というレトリックで貶める手法は悪質な障害者差別であり、許されるべきではない[37]。同時に、左派というレッテルを貼ることで議論の相手をとるに足りないものだとみなす振る舞いそのものが左派への差別を加速させると同時に、エキストリーム・センター的な状況を招くことも指摘しておきたい[38]。

ニュースレター、登録は無料でもできます。よろしければ。

脚注

[1]Donald Trump, Truth Social post, February 27, 2026. The Register, "Trump orders feds to drop 'woke' Anthropic after AI spat," February 27, 2026. https://www.theregister.com/2026/02/27/trump_orders_purge_of_anthropic/

[2]Pete Hegseth, post on X, February 27, 2026. Business Today, "'Radical left, woke company': Trump blacklists Anthropic as Claude maker refuses Pentagon demands," February 28, 2026.

[3]WION, "AI in warfare is here: Pentagon used Anthropic's Claude AI in Iran strikes," February 28, 2026.

[4]Washington Examiner / Colorado Springs Gazette, "Anthropic backers gave $174M to Democrats before firm's federal AI vendor list approval," September 7, 2025. https://www.washingtonexaminer.com/policy/technology/3795645/anthropic-backers-donated-democrats-federal-ai-vendor-list/ アルトマンのバイデン献金とトランプへの転向についても同記事。

[5]Ibid.

原文:"Anthropic is a safe haven for Biden officials who are diametrically opposed to President Trump's America First AI policy and are trying to weasel their way into the national security space."

[6]CBS News, "Pentagon gave Anthropic an ultimatum: Allow unrestricted military use of its AI or face a ban," February 27, 2026. https://www.cbsnews.com/news/pentagon-anthropic-dario-amodei-cbs-news-interview-exclusive/

[7]Jacob Sullum, "Trump thinks any judge who rules against him is in league with the 'radical left'," Reason, February 27, 2026. https://reason.com/2026/02/27/trump-thinks-any-judge-who-rules-against-him-is-in-league-with-the-radical-left/

原文:"The purpose of these epithets is not to describe the actual views of those people but to cast them as extremists whose opinions are not worth considering."

[8]NPR, "Trump has made more than 100 threats to prosecute or punish perceived enemies," October 21, 2024.

[9]ABA Journal, "Meet the federal judge labeled 'radical left lunatic' by Trump," March 2025.

[10]CBS News, "Federal judges who've ruled against Trump administration denounce threats against themselves, their families," March 2, 2026. https://www.cbsnews.com/news/federal-judges-whove-ruled-against-trump-administration-denounce-threats-60-minutes-transcript/

[11]TechCrunch, "Anthropic teams up with Palantir and AWS to sell its AI to defense customers," November 7, 2024. https://techcrunch.com/2024/11/07/anthropic-teams-up-with-palantir-and-aws-to-sell-its-ai-to-defense-customers/

[12]The Register, "Claude enlists: Anthropic's AI now available to defense, intelligence agencies," November 9, 2024. https://www.theregister.com/2024/11/07/anthropic_palantir_aws_claude/

[13]BTS Times, "Trump Blacklists Anthropic After AI Safeguards Clash, $200 Million Pentagon Deal Shifts to OpenAI," February 28, 2026.

[14]WSWS, "AI company Anthropic faces Trump administration threats," February 25, 2026.

[15]Anthropic, "Statement on Department of War," February 27, 2026. https://www.anthropic.com/news/statement-department-of-war

[16]Bloomsbury Intelligence Institute (BISI), "Pentagon AI Integration and Anthropic Ethics Strategy," February 22, 2026.

[17]The Hill, "Trump bans federal use of Anthropic technology," February 27, 2026. https://thehill.com/policy/technology/5759399-trump-bans-anthropic-tech/ またAnthropic声明[11]。

[18]BISI, 前掲。Googleは2025年2月にProject Maven以来の兵器開発・監視禁止方針を撤回。OpenAIは2024年1月に軍事利用の明示的禁止を削除。

[19]Semafor, "Palantir partnership is at heart of Anthropic-Pentagon rift," February 17, 2026. https://www.semafor.com/article/02/17/2026/palantir-partnership-is-at-heart-of-anthropic-pentagon-rift

[20]Ibid.

[21]NPR, "Anthropic refuses to back down despite Defense Department deadline," February 26, 2026. https://www.npr.org/2026/02/26/nx-s1-5727847/anthropic-defense-hegseth-ai-weapons-surveillance

[22]The Hill, 前掲。

原文:"New language framed as compromise was paired with legalese that would allow those safeguards to be disregarded at will."

[23]Fortune, "OpenAI sweeps Pentagon contract hours after Anthropic designated supply chain risk," February 28, 2026.

[24]The Conversation, "Anthropic v the US military: what this public feud says about the use of AI in warfare," February 26, 2026. https://theconversation.com/anthropic-v-the-us-military-what-this-public-feud-says-about-the-use-of-ai-in-warfare-276999

[25]+972 Magazine, "'Lavender': The AI machine directing Israel's bombing spree in Gaza," April 3, 2024. https://www.972mag.com/lavender-ai-israeli-army-gaza/ Lavenderのスコア承認は1件あたり約20秒。Where's Daddy?は標的の帰宅を検知するシステム。

[26]Truthout, "Organizers Are Demanding Palantir Drop Contracts With ICE and Israeli Military,"

[27]CBS News, 前掲。「Anthropicは現在、データ分析大手Palantirとの提携を通じて、ペンタゴンの機密ネットワークにモデルが展開されている唯一のAI企業だ」。

[28]Weber, J. and Suchman, L. (2016), "Human-Machine Autonomies," in Bhuta, N. et al. (eds.), Autonomous Weapons Systems: Law, Ethics, Policy, Cambridge University Press, pp.75–102. 自律性を機械固有の属性ではなく人間と機械の社会技術的配置から生じる効果として捉え直す。

[29]Suchman, L. (2015), "Intervening in the 'rise' of the lethal autonomous weapon," Scientists for Global Responsibility. https://www.sgr.org.uk/resources/intervening-rise-lethal-autonomous-weapon 原文:"delegating the 'decision to kill' to machines means removing the element of human deliberation typically associated with the word 'decision'."

[30]AFSC Investigate, "Palantir Technologies Inc." https://investigate.afsc.org/company/palantir ティールのIn-Q-Tel出資、カープの「反ウォーク」発言は2025年Earnings Call。

[31]Bloomberg, "Thiel's Palantir, Israel Agree Strategic Partnership for Battle Tech," January 2024.

[32]+972 Magazine / Local Call / The Guardian, "Inside the Israeli intelligence operation that used Microsoft cloud to surveil Palestinians," August 7, 2025. https://www.972mag.com/microsoft-cloud-israel-8200-expose/

[33]Time Magazine, February 24, 2026. また The Conversation, 前掲。原文:"scrapping the promise to not release AI models if Anthropic can't guarantee proper risk mitigations in advance." カプランの発言:"We didn't really feel, with the rapid advance of AI, that it made sense for us to make unilateral commitments … if competitors are blazing ahead."

[34]Morozov, E. (2013), To Save Everything, Click Here: The Folly of Technological Solutionism, PublicAffairs. モロゾフはソリューショニズムを「技術的手段で解決できるように問題を再定義する志向」として批判した。

[35]Mouffe, C. (2005), On the Political, Routledge. 邦訳:シャンタル・ムフ『政治的なものについて——闘技的民主主義と多元主義的グローバル秩序の構築』酒井隆史監訳、明石書店、2008年。「ポスト政治」概念は、政治的対立を技術的・管理的問題に還元する傾向を批判する。ムフの「闘技的多元主義」については以下も参照。Mouffe, C. (2000), The Democratic Paradox, Verso.

[36]Buyl, M. et al. (2026), "Large language models reflect the ideology of their creators," npj Artificial Intelligence, 2:7.

[37]政治のシーンで横行している障害者差別のレトリックについてはポリタスTV「週刊ニュースめった刺し」で相棒の高島鈴さんと語っているのでよければどうぞ。「発達障害を理由にクビ──それ不当解雇です/労組に入ろう!労組を作ろう!!【よりぬきポリタスTV】《岡田麻沙x高島鈴(週刊ニュースめった刺しより)》」

[38]酒井隆史・山下雄大編(2025)『エキストリーム・センター』以文社。無料でアクセスできる資料としては、以下。

酒井隆史インタビュー「政治と社会運動に広がる、エキストリーム・センター(極中道)思想」人民新聞、2026年1月5日。

すでに登録済みの方は こちら